China suspende chatbots de IA durante el gaokao: lecciones para la educación y la equidad

china suspende chatbots de inteligencia artificial durante el gaokao. Igual te suena a titular sacado de una novela de ciencia ficción, pero no. Esto es noticia fresca y muy real del gigante asiático. Lo que ha pasado estos días en China no solo llama la atención por lo inédito, también porque apunta directo al corazón de un debate global: ¿cómo gestionar la innovación cuando se pone en juego algo tan serio como la igualdad de oportunidades en la educación?

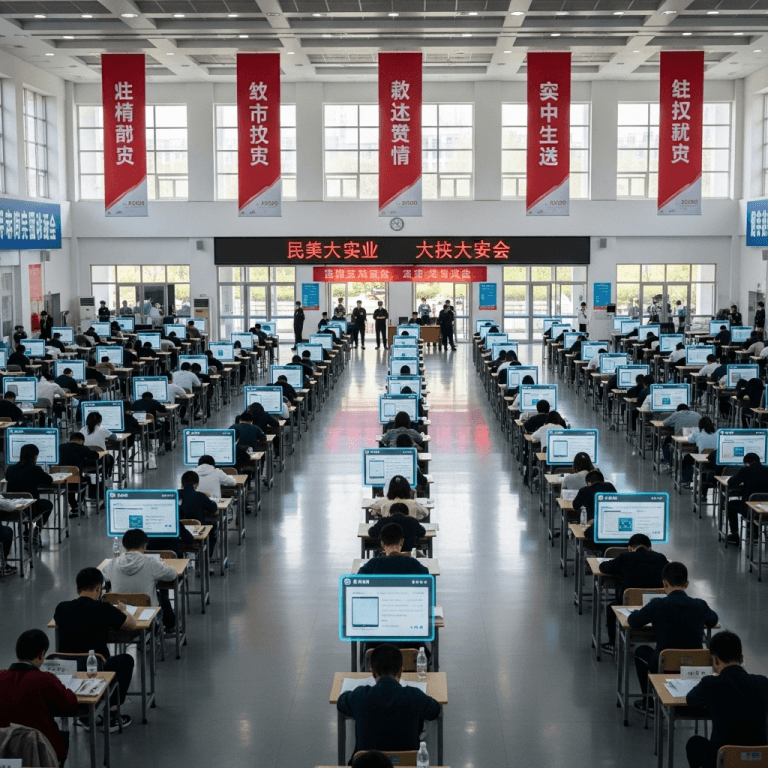

Pausa un segundo y piensa: más de 13,4 millones de estudiantes jugándose su futuro en el examen universitario más importante del país, el gaokao. Un evento con tintes de “rito de paso” nacional, seguido por familias enteras, donde cada punto puede marcar la diferencia entre acceder a una de las 147 universidades top o quedarse fuera. Es más: para buena parte de la clase media y sobre todo para jóvenes de zonas rurales o menos favorecidas, sacar una buena nota en el gaokao sigue siendo la mejor (y a veces única) palanca para aspirar a un futuro mejor.

Ahora imagina que, a unas horas de enfrentarse a ese desafío titánico, llega la noticia: los principales chatbots de inteligencia artificial quedarán suspendidos temporalmente durante los días del examen, entre el 7 y el 10 de junio. Ojo, hablamos de nombres tan grandes como Alibaba, Tencent, ByteDance o Moonshot, que no es poca cosa. De repente, las funciones estrella de estos asistentes digitales, desde el reconocimiento de imágenes hasta la resolución de preguntas a la carta, dejan de estar disponibles, justo cuando más podrían tentar a quienes buscan cualquier ventaja (legal o no tanto).

“El gaokao es el principal filtro de acceso universitario en China, un proceso crítico para la movilidad social y la meritocracia.”

¿Por qué lo han hecho? Las autoridades educativas chinas lo tienen claro: la prioridad es proteger la integridad académica y minimizar cualquier intento de trampas. No es casualidad que la medida coincida con una preocupación creciente sobre el posible uso indebido de la inteligencia artificial en exámenes, sobre todo a raíz de la popularidad explosiva de los chatbots generativos y a la capacidad de esta tecnología para resolver problemas, escribir ensayos o analizar imágenes en tiempo real. Y es que el debate sobre si la IA puede poner en peligro o no la igualdad de condiciones en contextos críticos acaba de hacerse tangible en China.

No lo digo a la ligera. El gaokao puede llegar a determinar décadas de vida. Quien no logra la nota necesaria ve cerrarse muchas puertas, así que la presión es brutal. Esta vez, la tecnología, siempre vista como aliada para aprender más rápido o resolver dudas, se ha convertido en sospechosa en potencia. De ahí que el gobierno no haya dudado en actuar: los chatbots de inteligencia artificial, en stand by durante los días clave, para impedir cualquier tentación de utilizar respuestas asistidas o reconocimiento de imágenes en tiempo real. Básicamente, un cortafuegos digital puesto en marcha a nivel nacional.

Pero esta suspensión de chatbots de inteligencia artificial durante el gaokao no es una simple anécdota. Marca un antes y un después, al menos en el debate sobre los límites entre tecnología e integridad educativa. Porque el contexto importa. China no sólo es un gigante en adopción tecnológica, es quizá el primer país en instalarse plenamente en la era de la inteligencia artificial generativa. De hecho, el 83 % de sus profesionales afirma usar estas herramientas de forma habitual en su vida diaria, algo muy por encima de la media global. Así que la decisión llega en un país donde la IA está impregnando cada rincón del día a día, desde la fábrica más puntera al aula más modesta.

Desde fuera, puede parecer una jugada radical. Pero si piensas en el ritmo de transformación digital que vive China, en su tendencia a regular de forma intensa donde detecta riesgos y a abrir paso libremente sólo donde todo está bajo control, la secuencia resulta lógica. El examen más importante del calendario educativo coincide, justo, con el momento de mayor escrutinio sobre el uso ético y seguro de la inteligencia artificial en el país. Mucho en juego, muchas expectativas, muchas dudas. Y, sobre todo, una presión social inmensa para demostrar al mundo que la innovación tecnológica, por muy potente que sea, no puede estar por encima de la confianza en el sistema educativo.

¿Por qué el gaokao es tan importante en China?

No exagero si digo que hablar del gaokao es hablar del futuro de millones de personas. Es más que un examen: es casi una institución nacional. Hay quien lo compara con el MIR español o con las selectividades europeas, pero el nivel de competencia y presión aquí es único. Familias enteras organizan su año en torno a la fecha del gaokao. Los estudiantes se someten, literalmente, a maratones de estudio de meses, casi sin descanso, en un ambiente donde lo académico roza lo obsesivo.

El motivo es simple: las mejores universidades chinas sólo aceptan a quienes logran las notas más altas en el gaokao, y el acceso se decide por pura meritocracia. No hay otra vía. Esto significa que, para millones de jóvenes (especialmente de entornos rurales o con menos recursos), el gaokao es tal vez la única herramienta de movilidad social real. Saltar este obstáculo no sólo permite estudiar en centros de prestigio; cambia vidas, familias, panoramas enteros.

Queda claro entonces por qué se ponen tan serios con cualquier amenaza a la “limpieza” del proceso. Y en ese contexto, la suspensión temporal de los chatbots de inteligencia artificial es mucho más que una restricción tecnológica aislada. Es una declaración de intenciones: en materia educativa, la equidad y la confianza pesan más que cualquier innovación.

“Proteger la integridad de los exámenes universitarios es visto en China como un acto de justicia social de primer orden.”

Claro, esto no se improvisa de la noche a la mañana. La decisión parte de meses de discusión entre autoridades educativas, tecnológicas y legales, todas apuntando a un temor común: si la inteligencia artificial llega a usarse como atajo para sobrevivir al gaokao, la confianza en el sistema se tambalearía y la sociedad entera podría sentir que el esfuerzo ya no sirve para nada.

Un termómetro de los tiempos: ¿Qué representa esta decisión?

Si me preguntas por qué está en boca de todos el que china suspenda los chatbots de inteligencia artificial durante el gaokao, la respuesta es sencilla: estamos ante un punto de inflexión. Es la primera vez que una nación tan avanzada en tecnología decide, sin titubeos, apagar los motores de la IA temporalmente para blindar la integridad académica. No se puede decir que eso pase desapercibido.

Pero va más allá. El episodio es, también, una metáfora potente del dilema con el que lidia hoy todo el mundo: ¿cómo conjugar el uso de la inteligencia artificial para aprender, innovar y progresar, sin que se convierta en un riesgo para el mérito, la honestidad y la igualdad?

En China, el gaokao y los chatbots de IA se han convertido así en el escenario de una batalla silenciosa pero decisiva, donde cada medida cuenta y donde las reglas del juego se reescriben casi sobre la marcha.

Motivos detrás de la suspensión de chatbots de IA en el gaokao: consecuencias y el nuevo blindaje tecnológico

A ver, pongamos las cartas sobre la mesa: la decisión de suspender los chatbots de inteligencia artificial durante el gaokao no ha sido fruto de un arrebato ni responde a un simple protocolo anticuado, sino que surge de un análisis quirúrgico de riesgos por parte de las autoridades chinas. Lo explico con claridad porque a veces, desde fuera, estas medidas pueden parecer propias de un gobierno hipercontrolador —cuando lo cierto es que responden a dinámicas mucho más complejas y actuales, donde la innovación va a toda velocidad y el sistema educativo tiene que bailar sobre esa cuerda floja sin caerse.

¿Por qué exactamente se ha tomado esta decisión? Básicamente, porque hablamos de chatbots de inteligencia artificial capaces de resolver ejercicios matemáticos, explicar ensayos históricos y analizar imágenes en cuestión de segundos —todo desde un móvil, una tablet, cualquier dispositivo. Imagínate lo fácil que sería para un estudiante, en situación de presión total, consultar respuestas durante la prueba si la tentación está justo allí, a un clic de distancia. Por mucho que confíes en la ética de los estudiantes, el riesgo está servido. Y aquí es donde entra en juego la tecnología como facilitadora… o como riesgo de trampa.

El temor real de las autoridades chinas es que el acceso libre a la inteligencia artificial durante los exámenes altere el sentido mismo del gaokao: evaluar la capacidad real y el esfuerzo de cada participante. Y para evitarlo no basta con confiar en la “buena voluntad” o apelar al honor. Hay que anticiparse. Por eso, durante los días señalados (del 7 al 10 de junio), gigantes como Alibaba, Tencent, ByteDance y Moonshot recibieron la instrucción directa y firme de desconectar funciones esenciales de sus asistentes digitales. No sólo el simple chat; hablamos del reconocimiento de imágenes, las funciones de “pregunta-responde” instantánea y cualquier interfaz capaz de dar soporte durante el examen. Básicamente, la IA generativa fue sacada del ring antes siquiera de sonar la campana.

¿En qué consistió, exactamente, esa “intervención de emergencia”? Te lo desgloso:

- Desactivación de chatbots de IA: Las plataformas líder dejaron fuera de servicio aquellas funcionalidades susceptibles de uso fraudulento: resolver problemas matemáticos, escribir ensayos o interpretar documentos visuales a tiempo real. Sin acceso, sin posibilidad de atajo.

- Inhabilitación del reconocimiento de imágenes: Este punto fue clave. La IA, alimentada con una simple foto de un ejercicio o texto, puede generar respuestas automáticas. Por eso, durante el gaokao, todo lo que oliera a reconocimiento visual fue bloqueado.

- Limitación estricta de otras aplicaciones: Más allá de los chatbots, China desplegó un arsenal de medidas preventivas: bloqueo de apps sospechosas, revisiones periódicas de las tiendas digitales y monitorización en tiempo real de descargas inusuales.

Todo esto por sí solo ya habría elevado el listón, pero el “cortafuegos” no acabó ahí. Para blindar el proceso —en serio, aquí no se andan con medias tintas— desplegaron otras capas de seguridad tecnológica y física:

- Verificación biométrica: Nada de suplantaciones ni cambios de última hora. Reconocimiento facial y huellas digitales para validar la identidad al entrar en el recinto del examen.

- Monitoreo con IA: Así como lo lees. La inteligencia artificial fue usada también para vigilar: algoritmos que detectan patrones de comportamiento sospechosos, tanto en el acceso a redes como en el propio entorno físico del examen.

- Inhibidores de señales: Adiós a la conexión móvil dentro del centro de exámenes. Se utilizaron barreras tecnológicas para impedir cualquier tipo de comunicación digital.

- Escaneo de dispositivos electrónicos: Revisiones al detalle de móviles, relojes inteligentes o cualquier otro gadget capaz de conectarse a internet o soportar apps de IA.

Pero, ¿cuáles han sido las consecuencias prácticas de todo este despliegue? El impacto se siente sobre todo en los más de 13,4 millones de estudiantes que han participado en la convocatoria de este año. De un día para otro, muchos se han visto privados de herramientas que, si bien pueden ser de apoyo durante el aprendizaje, resultan problemáticas en un contexto competitivo y bajo presión.

Algunos lo ven como una vuelta al pasado, obligando a depender sólo del “coco” y lo memorizado. Otros, en cambio, agradecen ese refuerzo de las garantías para que nadie haga trampas usando tecnología puntera. Me ha llamado la atención, además, el efecto psicológico: si la IA no está disponible, se elimina la incertidumbre sobre si otros la usarán para sacar ventaja, y baja una dosis de ansiedad entre quienes temen quedar rezagados por no dominar el último truco digital.

La decisión, sin embargo, deja preguntas pendientes para después del gaokao. ¿Debe la educación seguir adaptándose a la tecnología en modo reactivo, apagando fuegos cada vez que aparece una herramienta disruptiva? ¿O hay que anticiparse y rediseñar tanto los exámenes como las dinámicas de aprendizaje para que la inteligencia artificial pueda ser aliada, no enemiga? De momento, la prioridad ha sido proteger la limpieza del proceso selectivo más importante del país. Pero el pulso entre innovación y control está lejos de haberse resuelto.

“Prohibir no basta; hace falta repensar cómo y dónde encajan la IA y la educación en el siglo XXI.”

¿Y cómo se han gestionado los riesgos de que las nuevas generaciones se habitúen a “competir” entre humanos y algoritmos? Pues, a base de medidas excepcionales y vigilancia reforzada. Este despliegue extraordinario no es, ni de lejos, la norma estándar, pero sí marca un precedente poderoso. Lo ocurrido con los chatbots de inteligencia artificial durante el gaokao sentará las bases de futuras regulaciones y abrirá un debate (que ya toca) en todos los sistemas educativos avanzados del mundo.

Por ahora, la conclusión inmediata es clara: en contextos críticos como el gaokao, China prefiere parar la máquina de la IA antes que arriesgarse a que haga saltar por los aires la confianza en uno de sus ritos nacionales de movilidad social. ¿Volveremos a ver restricciones de este calibre en otros países o exámenes decisivos? Si la tecnología sigue avanzando al ritmo actual, todo apunta a que sí. La polémica, al menos, está servida.

Reacciones frente a la suspensión de chatbots de inteligencia artificial: debate social y académico en plena efervescencia

Vale, ahora vamos a lo jugoso de verdad: ¿cómo ha caído toda esta suspensión de chatbots de inteligencia artificial en el gaokao entre quienes viven (y sufren) el proceso en primera persona? Aquí no existe una sola voz ni un único argumento, ni mucho menos. De entrada, lo que hemos visto es un choque de percepciones muy representativo de los tiempos que corren, donde cualquier novedad tecnológica desata una auténtica tormenta de opiniones cruzadas.

En el bando de los defensores de la medida, destacan sobre todo los docentes, directores de institutos y autoridades educativas. No les tiembla el pulso al declarar —público y en privado— que era preferible un “apagón digital” durante el gaokao a arriesgar la credibilidad de todo el sistema. ¿Su argumento principal? El principio de equidad: si permites a algunos estudiantes usar chatbots de inteligencia artificial durante el examen y a otros no (porque igual carecen de acceso a ciertos dispositivos o conocimientos técnicos), el terreno de juego deja de ser parejo y la meritocracia desaparece por completo.

“Neutralizar la influencia de la tecnología durante los exámenes es preservar el sentido mismo de la evaluación objetiva.”

Pero claro, esa visión —muy alineada con lo que esperan los gestores de la educación pública— no refleja el sentir generalizado entre el alumnado. Entre los estudiantes, predomina una mezcla de resignación, dudas y, en algunos casos, una cierta indignación. Muchos argumentan que las herramientas de IA no son el enemigo, sino el síntoma de un cambio profundo. La queja más común: si la escuela no se adapta a los nuevos tiempos, siempre irá varios pasos por detrás de los problemas reales. ¿No sería más inteligente rediseñar el gaokao —o mejor dicho, todo el modelo de evaluación— para integrar la tecnología de manera ética y provechosa?

Pues bien, aquí nos topamos de frente con el abismo generacional. Mientras el profesorado insiste en la “disciplina digital”, muchos jóvenes ven la suspensión casi como un castigo colectivo. “Prohibir la IA por miedo a las trampas es como prohibir las calculadoras en los años 80”, me comentó un estudiante en un foro online chino. “La respuesta a la desconfianza no debería ser la censura, sino el aprendizaje crítico”. Frases así —que resuenan tanto en foros tecnológicos como en redes sociales chinas— muestran hasta qué punto existe una brecha entre quienes diseñan las reglas y quienes las padecen.

¿Es la educación china demasiado rígida ante la ola tecnológica?

No solo el alumnado alza la voz. Buena parte del ecosistema académico e investigadores en ciencias de la educación también han aprovechado el caso para plantear preguntas incómodas sobre el modelo chino —y, de rebote, sobre muchos otros sistemas educativos avanzados. ¿No habremos convertido el control en un fin en sí mismo, olvidando que la educación real debe enseñar a gestionar la tecnología, no a temerla?

Por otro lado, algunas voces ven legítima preocupación en el enfoque del gobierno: el gaokao simboliza la última barrera para acceder al ascensor social, así que jugar con su limpieza sería una temeridad. Pero la realidad es que nadie espera que la vida futura, ni profesional ni académica, sea ajena a la inteligencia artificial —más bien, al revés. Un número nada despreciable de profesores universitarios ha aprovechado para pedir reformas urgentes del currículo y los exámenes. Aspiran a que se evalúe, más allá de la memoria y la repetición, la capacidad de pensar de forma autónoma y de usar la tecnología de forma ética y eficiente.

Dentro de las redes sociales —tanto dentro como fuera de China— el tema se ha viralizado con hashtags del tipo #GaokaoSinIA y #InnovaciónBajoControl. Los debates se han encendido especialmente entre desarrolladores tecnológicos, quienes temen que un exceso de celo regulatorio acabe desincentivando la creatividad y el uso responsable de la IA en el entorno educativo. Algunos incluso argumentan que la medida puede hacernos retroceder en ese delicado y necesario proceso de alfabetización tecnológica para las nuevas generaciones.

¿Qué dicen los padres y la opinión pública?

Te sorprendería saber que los padres —tradicionales protagonistas en cualquier conversación seria sobre educación en China— en este caso se muestran más divididos que nunca. Una parte ve con alivio la medida y prefiere un examen “a la vieja usanza”, donde la competencia dependa del esfuerzo puro y duro. Hay quienes han confesado, incluso, dormir mejor sabiendo que la “tentación digital” estuvo fuera de juego y que la igualdad no dependió del móvil más caro ni del acceso al último truco digital.

Sin embargo, otra facción —quizá menos ruidosa, pero igual de relevante— cree que las prohibiciones sistemáticas solo postergan el problema: la tecnología ya está aquí y formará parte intrínseca de la vida laboral y académica de sus hijos. ¿No sería más lógico enseñar a usarlas bien en vez de demonizarlas durante dos días al año?

Al final, la opinión pública en China (y ojo, también entre observadores extranjeros) parece dividida entre dos universos que no terminan de reconciliarse: el de quienes defienden el orden y la igualdad a toda costa y el de quienes piden abrir la mentalidad y ver la IA como oportunidad, no como amenaza. Lo que sí parece claro es que la jugada del gobierno ha provocado una oleada de reflexiones —y no pocas autocríticas— sobre hasta qué punto los sistemas educativos están, o no, a la altura de los desafíos que plantea la inteligencia artificial en pleno 2024.

¿Una desconfianza legítima o una falta de estrategia proactiva?

Otra derivada fascinante, que los expertos en ética tecnológica han elevado estos días, tiene que ver con la confianza. La decisión de suspender los chatbots de inteligencia artificial en el gaokao no solo refleja una cautela razonable ante la posibilidad de trampas. También evidencia, quizá, una cierta desconfianza básica: en el alumnado, en la educación para el uso ético y, más ampliamente, en la capacidad de la sociedad para auto-regularse frente a los avances tecnológicos.

“En vez de prohibir, ¿no podríamos innovar en los métodos y formatos de examen para que la IA pierda sentido como vía para las trampas?”

En definitiva: la reacción colectiva ante la suspensión de los chatbots de inteligencia artificial trasciende el caso chino. Remueve un dilema de fondo sobre quién y cómo define las reglas del juego en la frontera entre tradición y modernidad. ¿Qué pesa más: blindar la igualdad a corto plazo o impulsar la autonomía y el pensamiento crítico a largo plazo? No hay respuesta fácil. Pero si algo ha puesto en evidencia el pulso entre defensores y detractores es que la conversación sobre IA y educación debe dejar de ser tabú. El futuro de millones de estudiantes —y el de la propia innovación educativa— está, literalmente, en juego.

Perspectivas futuras y desafíos globales: el dilema de la IA, la educación y la equidad

La suspensión de chatbots de inteligencia artificial en el gaokao no se queda en una anécdota exótica al otro lado del mundo, créeme. Coloca sobre la mesa una situación que tarde o temprano va a pedir respuesta en todos los sistemas educativos: ¿cómo se gestiona la llegada masiva de la IA educativa sin arrasar con la equidad, ni retrasar a quienes sí quieren aprender usando estas tecnologías?

Mira, lo que acaba de hacer China es una especie de stress test para el resto del planeta. ¿La receta? Innovación, pero bajo control quirúrgico. Cuando el riesgo a la integridad supera el beneficio inmediato, la IA se apaga; el resto del año, desarrollo y uso a toda máquina. Fácil de enunciar, imposible de copiar sin adaptación local. Y aquí aparece la pregunta para cualquier país que esté pensando en ir por la vía rápida de la digitalización educativa: ¿sirve realmente el enfoque de prohibición temporal o necesitamos un rediseño de los exámenes, las materias, y hasta las propias competencias a evaluar?

No es solo cuestión de evitar trampas aisladas. El techo es mucho más alto. Hablamos de rearmar los modelos de enseñanza, aprender a convivir con asistentes de IA y colocar a los estudiantes frente a retos donde “copiar” o “automatizar” la respuesta se vuelva irrelevante. Es decir, ¿por qué no plantear pruebas donde el sentido crítico, la creatividad y la capacidad de aplicarse a problemas inéditos sean lo único que marque la diferencia?

En ese futuro probable, el propio papel de la escuela se transforma. Si, como ya pasa en China, el 83 % de los profesionales usa IA a diario, formar para la vida implica enseñar a saber cuándo apoyarte en el algoritmo y cuándo tocar parar y pensar solo. El debate no es blanco o negro: ni prohibición total ni barra libre digital, y los países que entiendan esto antes van a sacar ventaja. Porque, a ver, ¿qué pasa si otros sistemas copian la “solución china” sin entender el contexto local? Tal vez se llenarán los titulares durante unos días, pero la tensión persistirá… o crecerá.

Hazte estas preguntas:

- ¿Dónde está la línea de lo admisible entre ayuda digital y trampa descarada?

- ¿Deberíamos rediseñar las evaluaciones —y no solo “prohibir”— para que la IA se convierta en un recurso legítimo y controlado?

- ¿Sabemos formar a estudiantes críticos, capaces de entender los límites técnicos, los sesgos y los riesgos de la IA?

- ¿Quién debería pilotar la regulación: los gobiernos, las instituciones educativas, las tecnológicas, o una combinación?

El caso del gaokao sin chatbots de IA forzará respuestas en todas esas dimensiones. No se puede improvisar un sistema confiable de la noche a la mañana. Mientras tanto, lo que demuestra China es que tener músculo regulador (pero también adaptación y vigilancia extrema) puede servir de amortiguador frente a los riesgos del “todo vale” tecnológico. No es que la innovación se frene, ni mucho menos —los datos de adopción de IA en China lo dejan bien claro—. Es que se avanza rápido, sí, pero con pies de plomo donde más se la juega la confianza social.

“Lo que está en juego no es solo quién entra a una universidad top, sino cómo una sociedad entera aprende a fiarse de los algoritmos… y de sí misma.”

Al fin y al cabo, si quieres que la IA tenga un efecto real de ascensor social y educativo, hay que diseñar marcos éticos, legales y técnicos que permitan aprovechar cada gota de su potencial… sin dinamitar la confianza colectiva en el mérito, la transparencia y el esfuerzo individual. Ese el gran reto, y la ventana de oportunidad que tenemos justo delante.

Quizá dentro de unos años, mirar atrás y recordar que el primer gran apagón de chatbots de inteligencia artificial durante un examen nacional fue solo el principio. Quizá entonces tengamos sistemas donde la IA esté tan integrada —y las reglas sean tan claras— que el miedo a la trampa resulte irrelevante. Pero para llegar a ese punto hay que empezar el debate hoy. Sin tapujos.

¿Qué harías tú? ¿Copiar el modelo chino, innovar en exámenes o apostar por la alfabetización digital avanzada?

- ¿Crees que la mejor defensa contra las trampas es la prohibición o el rediseño integral de las pruebas?

- ¿Ves a tu país preparado para un debate profundo sobre ética, mérito y tecnología en la educación?

- ¿Te consideras parte de quienes apuestan por innovación bajo control o prefieres el riesgo, confiando en la responsabilidad colectiva?

La ética digital y la evaluación justa van a marcar el futuro de generaciones enteras. China pone el listón y deja la pregunta en el aire. Ahora, el balón está en nuestro tejado.

Sergio Jiménez Mazure

Especialista en Inteligencia Artificial y Automatización B2B. Fundador de Innovación IA, dedicado a ayudar a empresas a integrar tecnologías cognitivas para maximizar su eficiencia operativa.